¿Cómo puede beneficiarse la ciencia de la IA?

Una publicación advierte de los malentendidos en el manejo de algoritmos predictivos

Los investigadores de química, biología y medicina recurren cada vez más a modelos de IA para elaborar nuevas hipótesis. Sin embargo, a menudo no está claro en qué se basan los algoritmos para llegar a sus conclusiones y hasta qué punto pueden generalizarse. Una publicación de la Universidad de Bonn advierte ahora de los malentendidos en el manejo de la inteligencia artificial. Al mismo tiempo, pone de relieve las condiciones en las que los investigadores pueden confiar más en los modelos. El estudio se publica ahora en la revista Cell Reports Physical Science.

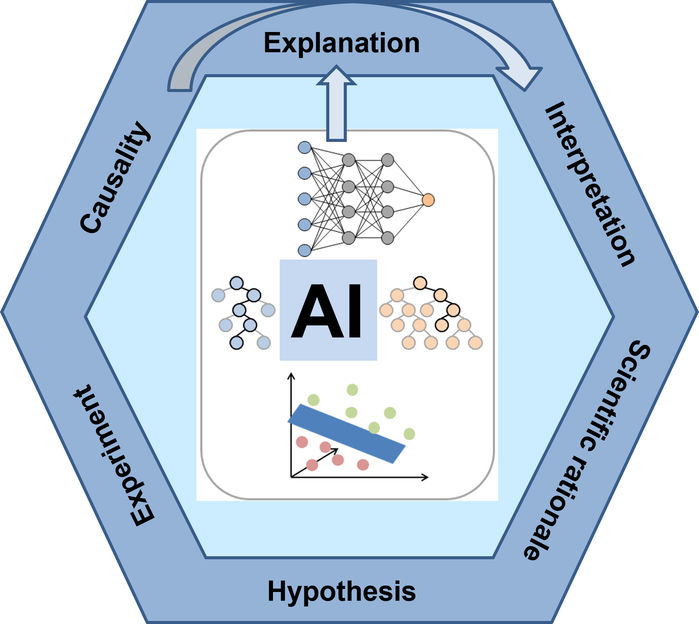

Modelos de IA en las ciencias naturales: - De explicar predicciones a captar relaciones causales.

Jürgen Bajorath/University of Bonn

Los algoritmos de aprendizaje automático adaptativo son increíblemente potentes. Sin embargo, tienen un inconveniente: la forma en que los modelos de aprendizaje automático llegan a sus predicciones no suele ser evidente desde el exterior.

Supongamos que se alimenta a la inteligencia artificial con fotos de varios miles de coches. Si ahora le presentas una nueva imagen, normalmente puede identificar con fiabilidad si la foto también muestra un coche o no. ¿Por qué? ¿Realmente ha aprendido que un coche tiene cuatro ruedas, un parabrisas y un tubo de escape? ¿O se basa en criterios irrelevantes, como la antena del techo? Si así fuera, también podría clasificar una radio como coche.

Los modelos de IA son cajas negras

"Los modelos de IA son cajas negras", subraya el Prof. Dr. Jürgen Bajorath. "En consecuencia, no hay que confiar ciegamente en sus resultados ni sacar conclusiones de ellos". El experto en química computacional dirige el departamento de IA en Ciencias de la Vida del Instituto Lamarr de Aprendizaje Automático e Inteligencia Artificial. También es responsable del programa de Informática en Ciencias de la Vida del Centro Internacional de Tecnologías de la Información de Bonn-Aachen (b-it) de la Universidad de Bonn. En la presente publicación, investigó la cuestión de cuándo es más probable confiar en los algoritmos. Y viceversa: cuándo no.

El concepto de "explicabilidad" desempeña un papel importante en este contexto. Metafóricamente hablando, se refiere a los esfuerzos dentro de la investigación de la IA para perforar una mirilla en la caja negra. El algoritmo debe revelar los criterios que utiliza como base: las cuatro ruedas o la antena. "Abrir la caja negra es actualmente un tema central en la investigación de la IA", afirma Bajorath. "Algunos modelos de IA se desarrollan exclusivamente para hacer más comprensibles los resultados de otros".

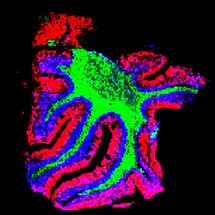

Sin embargo, la explicabilidad es sólo un aspecto: la cuestión de qué conclusiones pueden extraerse de los criterios de decisión elegidos por un modelo es igualmente importante. Si el algoritmo indica que ha basado su decisión en la antena, un ser humano sabe inmediatamente que esta característica es poco adecuada para identificar coches. A pesar de ello, los modelos adaptativos se utilizan generalmente para identificar correlaciones en grandes conjuntos de datos que los seres humanos podrían ni siquiera advertir. Somos entonces como extraterrestres que no saben qué es un coche: Un alienígena sería incapaz de decir si una antena es o no un buen criterio.

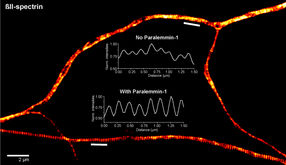

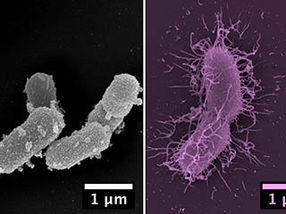

Los modelos de lenguaje químico sugieren nuevos compuestos

"Hay otra pregunta que siempre tenemos que hacernos cuando utilizamos procedimientos de IA en ciencia", subraya Bajorath, que también es miembro del Área de Investigación Transdisciplinar (TRA) "Modelización": "¿Hasta qué punto son interpretables los resultados?". Los modelos de lenguaje químico son actualmente un tema candente en la investigación química y farmacéutica. Es posible, por ejemplo, alimentarlos con muchas moléculas que tengan una determinada actividad biológica. A partir de estos datos de entrada, el modelo aprende y, en el mejor de los casos, sugiere una nueva molécula que también tiene esa actividad, pero con una estructura nueva. Esto también se conoce como modelización generativa. Sin embargo, el modelo no suele explicar por qué llega a esa solución. A menudo es necesario aplicar posteriormente métodos de IA explicables.

No obstante, Bajorath advierte contra la sobreinterpretación de estas explicaciones, es decir, anticipar que las características que la IA considera importantes causan realmente la actividad deseada. "Los modelos actuales de IA no entienden esencialmente nada de química", afirma. "Son puramente estadísticos y correlativos por naturaleza y prestan atención a cualquier rasgo distintivo, independientemente de si estos rasgos pueden ser química o biológicamente relevantes o no". A pesar de ello, es posible que incluso acierten en su valoración, por lo que tal vez la molécula sugerida tenga las capacidades deseadas. Sin embargo, las razones pueden ser completamente distintas de lo que esperaríamos basándonos en el conocimiento químico o la intuición. Para evaluar la causalidad potencial entre las características que impulsan las predicciones y los resultados de los procesos naturales correspondientes, normalmente se requieren experimentos: Los investigadores deben sintetizar y probar la molécula, así como otras moléculas con el motivo estructural que la IA considera importante.

Los controles de plausibilidad son importantes

Estas pruebas llevan mucho tiempo y son caras. Por ello, Bajorath advierte del peligro de sobreinterpretar los resultados de la IA en la búsqueda de relaciones causales científicamente plausibles. En su opinión, una comprobación de la plausibilidad basada en un razonamiento científico sólido es de vital importancia: ¿Puede la característica sugerida por la IA explicable ser realmente responsable de la propiedad química o biológica deseada? ¿Merece la pena seguir la sugerencia de la IA? ¿O es un artefacto probable, una correlación identificada al azar, como la antena del coche, que no es relevante en absoluto para la función real?

El científico subraya que el uso de algoritmos adaptativos tiene fundamentalmente el potencial de hacer avanzar sustancialmente la investigación en muchas áreas de la ciencia. No obstante, hay que ser consciente de los puntos fuertes de estos enfoques y, sobre todo, de sus puntos débiles.

Nota: Este artículo ha sido traducido utilizando un sistema informático sin intervención humana. LUMITOS ofrece estas traducciones automáticas para presentar una gama más amplia de noticias de actualidad. Como este artículo ha sido traducido con traducción automática, es posible que contenga errores de vocabulario, sintaxis o gramática. El artículo original en Inglés se puede encontrar aquí.