Una nueva interfaz cerebro-ordenador permite a un hombre con ELA "hablar" de nuevo

Una tecnología desarrollada por UC Davis Health restablece la comunicación interpersonal

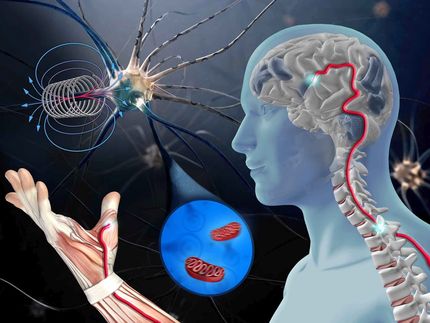

Una nueva interfaz cerebro-ordenador (BCI) desarrollada en UC Davis Health traduce las señales cerebrales en habla con una precisión de hasta el 97%, el sistema más preciso de su clase.

Casey Harrell con su asistente personal Emma Alaimo y el neurocientífico de la UC Davis Sergey Stavisky.

UC Regents

Los investigadores implantaron sensores en el cerebro de un hombre con graves dificultades para hablar debido a una esclerosis lateral amiotrófica (ELA). El hombre fue capaz de comunicar lo que quería decir a los pocos minutos de activar el sistema.

La ELA, también conocida como enfermedad de Lou Gehrig, afecta a las células nerviosas que controlan el movimiento de todo el cuerpo. La enfermedad conduce a una pérdida gradual de la capacidad para estar de pie, caminar y utilizar las manos. También puede hacer que una persona pierda el control de los músculos utilizados para hablar, lo que conduce a una pérdida del habla comprensible.

La nueva tecnología se está desarrollando para restablecer la comunicación de las personas que no pueden hablar por parálisis o afecciones neurológicas como la ELA. Puede interpretar las señales cerebrales cuando el usuario intenta hablar y convertirlas en texto que el ordenador "habla" en voz alta.

"Nuestra tecnología BCI ayudó a un hombre con parálisis a comunicarse con sus amigos, familiares y cuidadores", afirma David Brandman, neurocirujano de la UC Davis. "Nuestro trabajo demuestra la neuroprótesis (dispositivo) del habla más precisa de la que se tiene constancia".

Brandman es coinvestigador principal y coautor principal de este estudio. Es profesor adjunto del Departamento de Cirugía Neurológica de la UC Davis y codirector del Laboratorio de Neuroprótesis de la UC Davis.

El nuevo BCI rompe la barrera de la comunicación

Cuando alguien intenta hablar, el nuevo dispositivo BCI transforma su actividad cerebral en texto en la pantalla de un ordenador. A continuación, el ordenador puede leer el texto en voz alta.

Para desarrollar el sistema, el equipo inscribió a Casey Harrell, un hombre de 45 años con ELA, en el ensayo clínico BrainGate. En el momento de su inscripción, Harrell tenía debilidad en brazos y piernas (tetraparesia). Su habla era muy difícil de entender (disartria) y necesitaba que otros le ayudaran a interpretarla.

En julio de 2023, Brandman implantó el dispositivo BCI en investigación. Colocó cuatro conjuntos de microelectrodos en la circunvolución precentral izquierda, una región del cerebro responsable de la coordinación del habla. Las matrices están diseñadas para registrar la actividad cerebral de 256 electrodos corticales.

"Estamos detectando su intento de mover los músculos y hablar", explica el neurocientífico Sergey Stavisky. Stavisky es profesor adjunto del Departamento de Cirugía Neurológica. Es codirector del Laboratorio de Neuroprótesis de UC Davis y coinvestigador principal del estudio. "Estamos grabando la parte del cerebro que intenta enviar estas órdenes a los músculos. Básicamente, escuchamos y traducimos esos patrones de actividad cerebral en un fonema, como una sílaba o unidad del habla, y luego en las palabras que intentan decir".

Entrenamiento más rápido, mejores resultados

A pesar de los recientes avances de la tecnología BCI, los esfuerzos por hacer posible la comunicación han sido lentos y propensos a errores. Esto se debe a que los programas de aprendizaje automático que interpretaban las señales cerebrales requerían una gran cantidad de tiempo y datos para su ejecución.

"Los anteriores sistemas de BCI del habla tenían frecuentes errores en las palabras. Esto dificultaba la comprensión del usuario y suponía una barrera para la comunicación", explica Brandman. "Nuestro objetivo era desarrollar un sistema que permitiera a alguien hacerse entender siempre que quisiera hablar".

Harrell utilizó el sistema tanto en conversaciones espontáneas como con instrucciones. En ambos casos, la decodificación del habla se produjo en tiempo real, con actualizaciones continuas del sistema para que siguiera funcionando con precisión.

Las palabras descodificadas se mostraban en una pantalla. Sorprendentemente, se leían en voz alta con una voz que sonaba como la de Harrell antes de padecer ELA. La voz se compuso mediante un software entrenado con muestras de audio existentes de su voz antes de la ELA.

En la primera sesión de entrenamiento con datos de voz, el sistema tardó 30 minutos en alcanzar una precisión del 99,6% con un vocabulario de 50 palabras.

"La primera vez que probamos el sistema, lloró de alegría cuando las palabras que intentaba decir correctamente aparecieron en la pantalla. Todos lo hicimos", afirma Stavisky.

En la segunda sesión, el tamaño del vocabulario potencial aumentó a 125.000 palabras. Con sólo 1,4 horas adicionales de datos de entrenamiento, el BCI alcanzó un 90,2% de precisión en las palabras con este vocabulario tan ampliado. Tras una recopilación continuada de datos, el BCI ha mantenido una precisión del 97,5%.

"Llegados a este punto, podemos descodificar correctamente lo que Casey intenta decir el 97% de las veces, lo que es mejor que muchas aplicaciones comerciales para teléfonos inteligentes que intentan interpretar la voz de una persona", afirma Brandman. "Esta tecnología es transformadora porque da esperanza a las personas que quieren hablar pero no pueden. Espero que una tecnología como esta BCI del habla ayude a futuros pacientes a hablar con sus familiares y amigos."

El estudio recoge 84 sesiones de recogida de datos durante 32 semanas. En total, Harrell utilizó el BCI del habla en conversaciones a su propio ritmo durante más de 248 horas para comunicarse en persona y por videochat.

"No poder comunicarse es muy frustrante y desmoralizador. Es como estar atrapado", afirma Harrell. "Algo como esta tecnología ayudará a la gente a reincorporarse a la vida y a la sociedad".

"Ha sido inmensamente gratificante ver cómo Casey recuperaba la capacidad de hablar con su familia y amigos gracias a esta tecnología", afirmó el autor principal del estudio, Nicholas Card. Card es becario postdoctoral en el Departamento de Cirugía Neurológica de UC Davis.

"Casey y los demás participantes de BrainGate son realmente extraordinarios. Merecen un enorme reconocimiento por participar en estos primeros ensayos clínicos. No lo hacen porque esperen obtener algún beneficio personal, sino para ayudarnos a desarrollar un sistema que devolverá la comunicación y la movilidad a otras personas con parálisis", ha declarado Leigh Hochberg, coautor e investigador patrocinador del ensayo BrainGate. Hochberg es neurólogo y neurocientífico del Hospital General de Massachusetts, la Universidad de Brown y el sistema sanitario VA Providence.

Nota: Este artículo ha sido traducido utilizando un sistema informático sin intervención humana. LUMITOS ofrece estas traducciones automáticas para presentar una gama más amplia de noticias de actualidad. Como este artículo ha sido traducido con traducción automática, es posible que contenga errores de vocabulario, sintaxis o gramática. El artículo original en Inglés se puede encontrar aquí.

Publicación original

Nicholas S. Card, Maitreyee Wairagkar, Carrina Iacobacci, Xianda Hou, Tyler Singer-Clark, Francis R. Willett, Erin M. Kunz, Chaofei Fan, Maryam Vahdati Nia, Darrel R. Deo, Aparna Srinivasan, Eun Young Choi, Matthew F. Glasser, Leigh R. Hochberg, Jaimie M. Henderson, Kiarash Shahlaie, Sergey D. Stavisky, David M. Brandman; "An Accurate and Rapidly Calibrating Speech Neuroprosthesis"; New England Journal of Medicine, Volume 391